為何LLM會陷入確定性循環 (Deterministic Loops) ?

這篇主要由卡內基梅隆大學、加州大學柏克萊分校的研究論文(12 Oct 2025)『Limits of Emergent Reasoning of Large Language Models in Agentic Frameworks for Deterministic Games 』。主要是透過『LLM在處理漢諾塔問題』來探究為何LLM會陷入『確定性循環 (Deterministic Loops),也就是模型在遇到困境時,會陷入一種無法逃脫的、固定的、無效的循環動作』。

其實最近使用Google Antigravity,求解規劃一個鐵路排班的數學最佳化問題,用『Gemini 3 Pro (High)』和『Claude Sonnet 4.5』也是遭遇到一樣的問題。就如一直以來的論述,LLM是一個求解『Cross-Entropy(交叉熵)損失最小化』的數學最佳化問題,所以這個問題的推論就是陷入了『區域最佳解』所形成的『確定性循環 』,因此解法就是要讓問題跳出這個區域解,到另外一個山谷去找答案。

最終把這篇論文交給了Gemini Canvas,並經過問答之後,幫忙整理了一個簡報檔。

從實驗觀察到數學理論解釋 LLM 的推理限制-探討「性能崩潰」與「確定性循環」的根本成因

原始論文出處:

Limits of Emergent Reasoning of Large Language Models in Agentic Frameworks for Deterministic Games

Youtube參照來源:

別再迷信“湧現推理”|思考的幻覺?當AI的“湧現推理”撞上漢諾塔

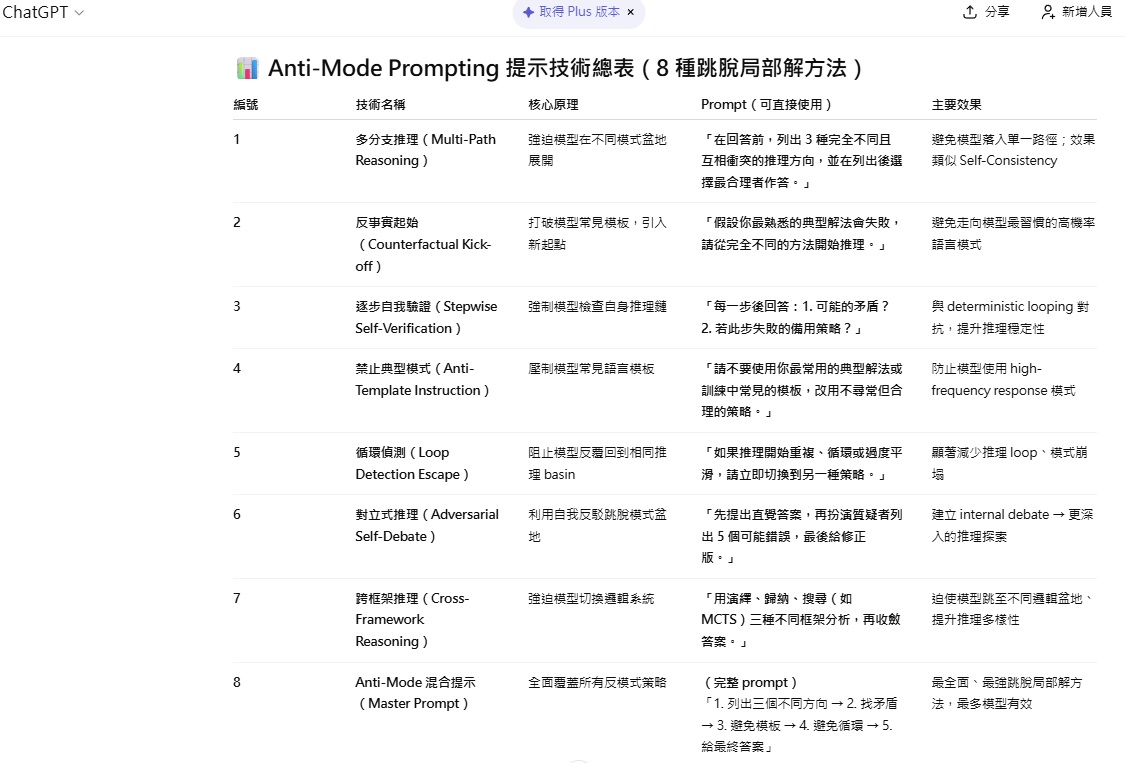

以下是ChatGPT 建議的8種跳脫局部解的提示詞:

CHATGPT、Claude建議跳出局部解的建議作法(僅供參考):

CHATGPT:

Claude:

作者:周大可