當漫畫遇上 AI:用 AI 打造沈浸式閱讀體驗

講者:Andrew | 遊戲橘子 | AI Researcher Intern

活動:10/15 Generative AI 年會小聚 2025

題目:當漫畫遇上 AI:用 AI 打造沈浸式閱讀體驗

演講簡介

講者是台大電信所的研究生,開場就說自己為了這個專案,看了很多 BL 漫畫XD,整個專案研究也真的圍繞著漫畫這個題材展開,非常特別。

講者從「讓漫畫有配樂」開始講起,想像一下,你在滑手機看條漫如韓漫,背景音樂會根據劇情自動變化,有的地方有腳步聲、緊張的地方突然一聲巨響,甚至能根據畫面節奏產生對應的音樂,這種全新的2D體驗,一定能讓你得到從未想像的沉浸式體驗。

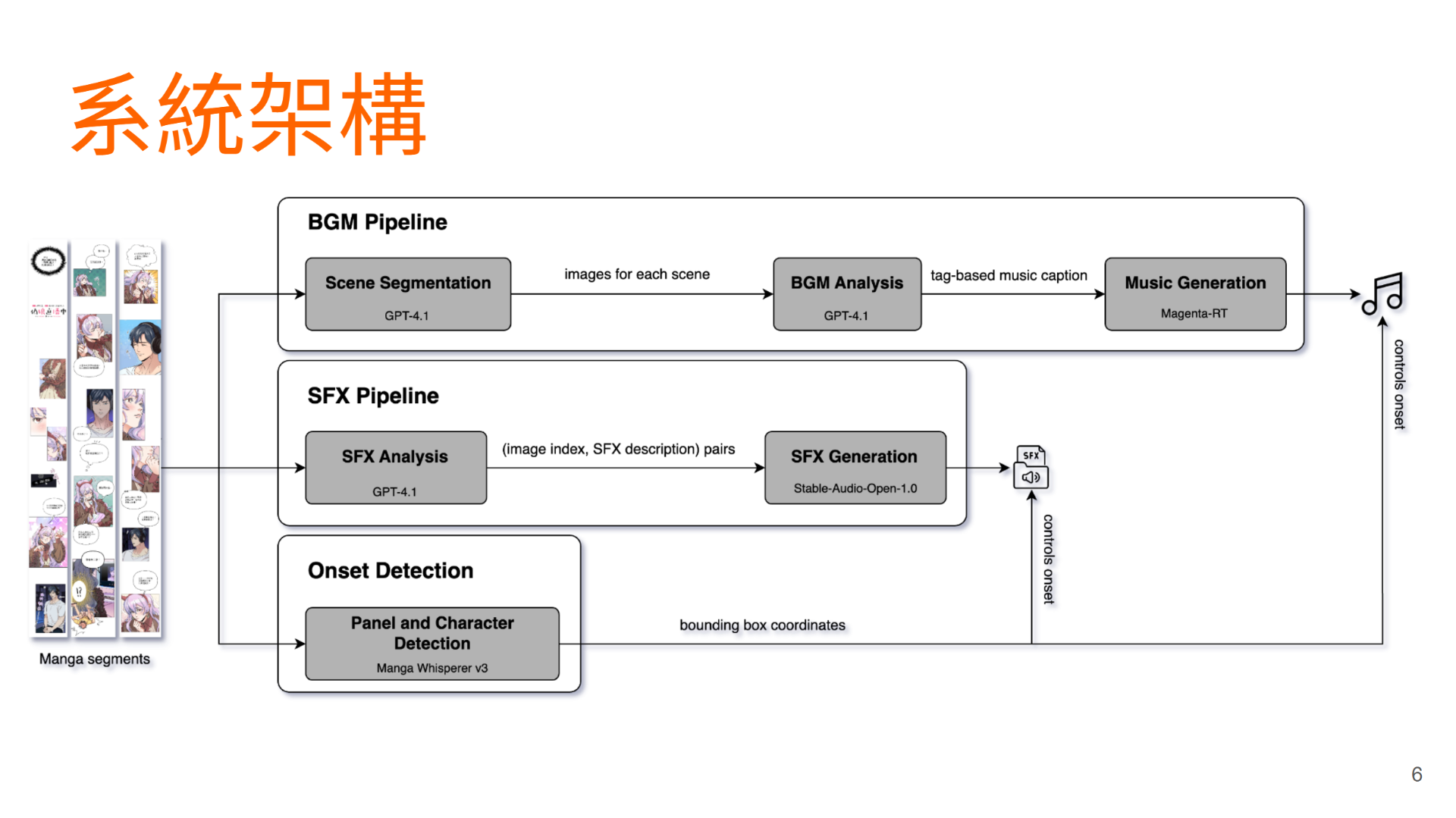

這中間用到的技術其實蠻多的,主要分成三個不一樣的過程:

BGM Pipeline:

使用 VLM (Vision Language Model) 去理解畫面內容,判斷哪一段劇情適合什麼樣的音樂,然後用 text-to-music 模型 (例如 Magenta RT) 自動作曲。SFX Pipeline:

圖片一樣先進到 VLM,分析出哪些地方該有音效,再透過 Stable-Audio-Open-1.0 生成對應的聲音。Onset Detection:

接著要考慮到在條漫中,讀者滑動到某個位置時(Y軸),某些音效要能剛好出現,時間點很講究,其中用到的工具包括 Megawhisper v3,可以精準定位腳步聲、jump scare 音效出現的位置。

講者直接 demo 了兩部作品《人面魚》和《虛娘直播中》都超有畫面感,真的更有帶入感,

總結

整個演講讓我感受到 AI 不只是讓漫畫更炫,而是讓閱讀變成沈浸式體驗,而且 VLM 已經不只是理解真實世界的影像,也能理解漫畫這樣的敘事媒介,在配合上 text-to-music,能讓單純的視覺加上聽覺,提供故事情感的延伸,讓讀者能更深刻地感受劇情節奏。

這讓我有種重新思考「閱讀」這件事的感覺,也更具體感受到,AI 不只是創作的工具,它也在改變我們「感受故事」的方式。

作者:Chi