Apple 發布開源影片生成模型:STARFlow-V

近幾年影像生成都是 diffusion 一家獨大,尤其是影片領域,不論是 Sora、Kling、Hailuo 等系統,背後都是大型擴散模型配合 autoregressive 或兩階段架構,但其實在生成模型的歷史裡,Normalizing Flows(NFs) 一直是個很純粹、很優雅的方向,可逆、端到端、直接算 likelihood,理論其實很乾淨,但就是沒人能在影片上把它做到好。

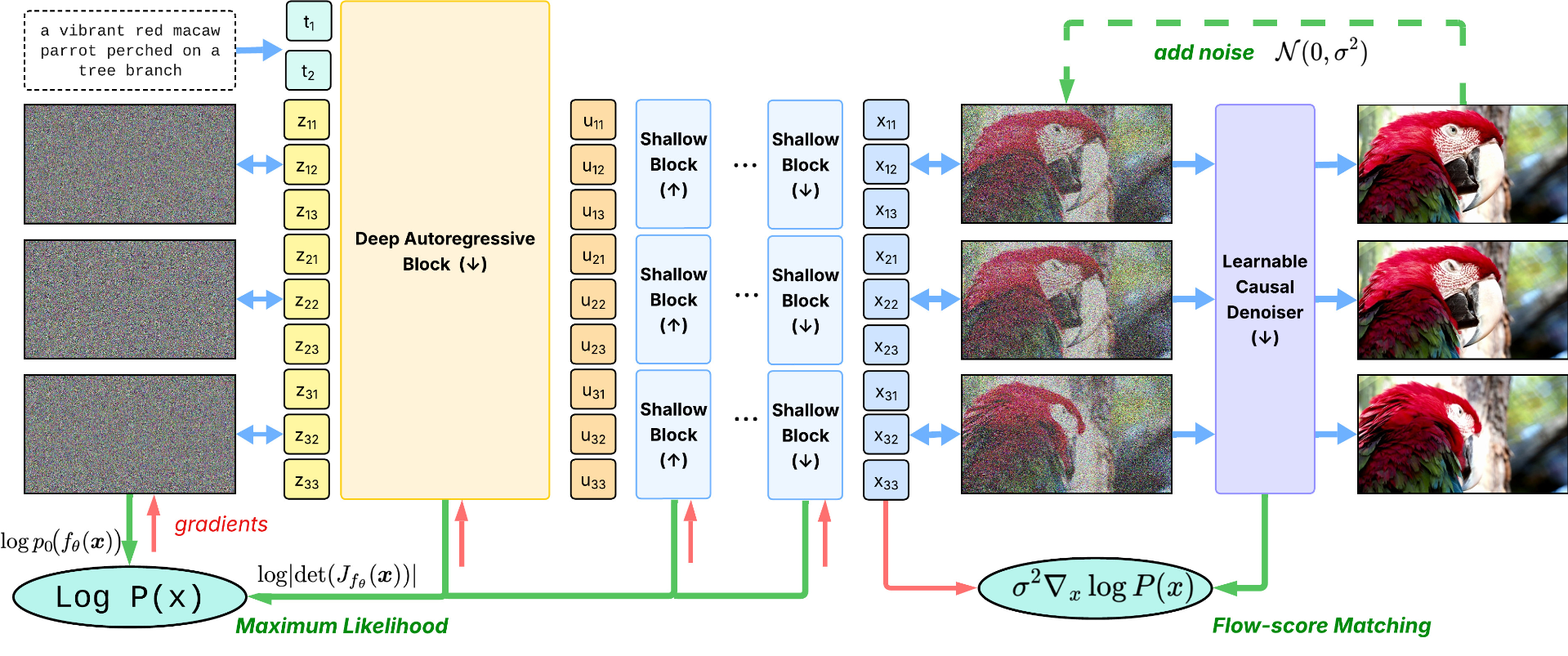

直到 Apple 最近法表的 STARFlow-V,我覺得非常酷炫,它不是一個噱頭,而是真正試著把 NF 重新帶回影片生成領域,並且有些成果看起來蠻有趣。

影片生成有兩個核心難題:

時間累積誤差:影片是序列,前面生成不穩後面就一路崩壞。

算力太貴:diffusion 本來就慢,影片再加時間維度,推論更是炸到不行。

而 STARFlow-V 的觀點是:

既然 diffusion 在序列生成容易卡死,那 NF 的可逆與端到端特性,能不能反而讓影片的自迴歸預測更穩?

這篇就是在驗證這件事,而且結果是 可以的。

STARFlow-V 不像 Sora 那樣華麗,但在研究圈應該是個 milestone:

NF + video generation 的第一次成功證據

在 autoregressive 影片生成開創新架構

提供 diffusion 以外的選擇(特別是 world model 方向)

如果你也正在研究視訊生成、世界模型、影片推論或可逆生成模型,這篇論文非常值得讀。

作者:林子豪