MME: A Comprehensive Evaluation Benchmark for Multimodal Large Language Models

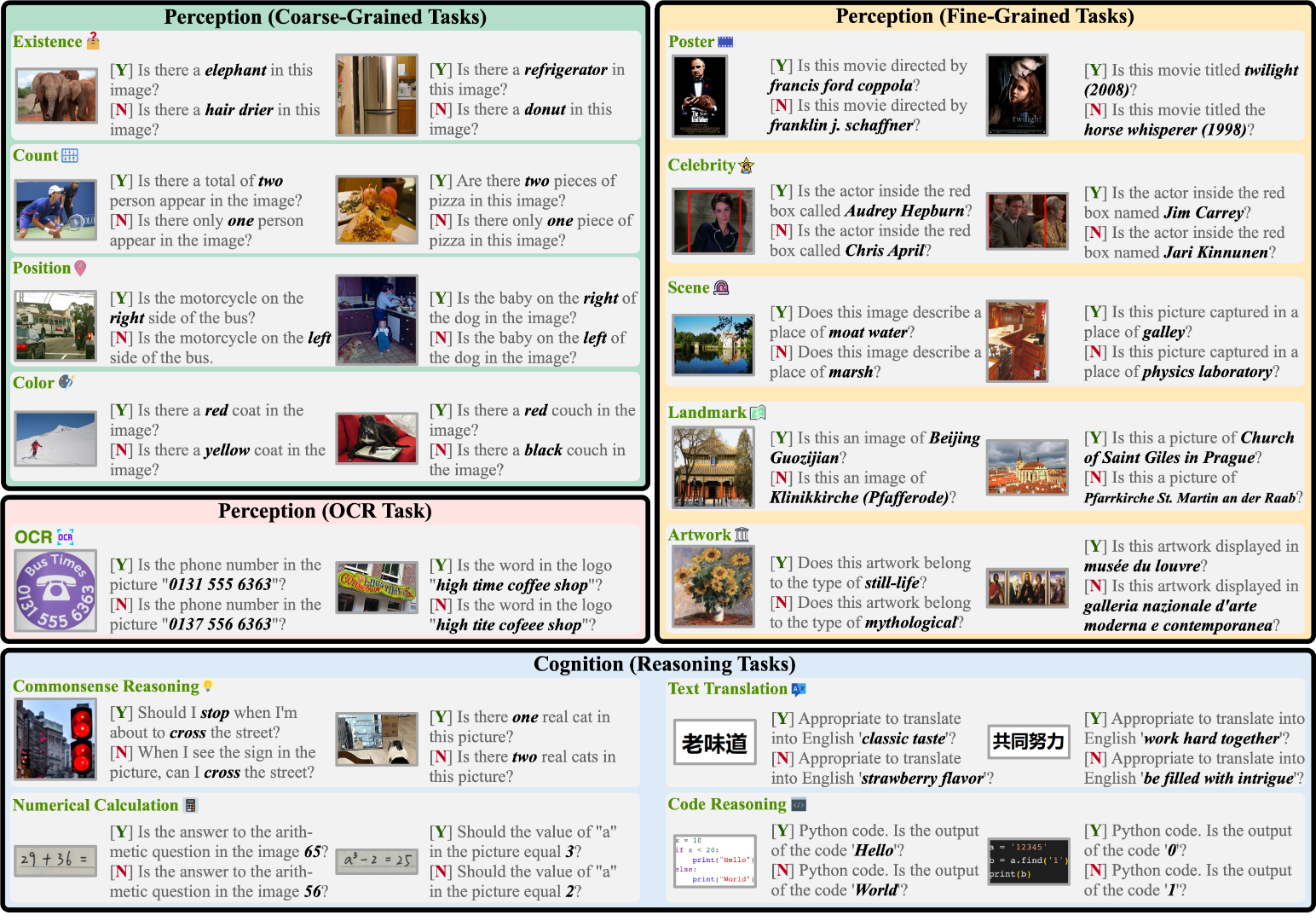

講到 MLLM 的 Benchmark,一定不會忽略從 2023 年就推出的 MME,到現在也出了 v5 版(2025年10月),MME 是第一個全面評估 MLLM 的 Benchmark,它從 perception 與 cognition 兩個層面來評估 LLM,包含 14 個子任務,如以下:

GitHub 有很詳細的介紹,包含各種子專案,像是 Video-MME、MME-RealWorld 等等,有興趣可以去看看。

作者:Chi