AI Evals FAQ

一直有在追 Hamel 的 blog,昨天他發了一篇 Evals FAQ,裡面整理了不少關於 AI 系統評估的常見問題,我覺得裡面幾個觀點滿值得拿出來討論。

第一:

評估不是單純跑幾個 benchmark 就結束。很多人會以為丟個數據集測一下分數,就能代表模型的實力。但實際上,模型的應用場景差異很大,benchmark 只是一種參考,往往沒辦法反映實際落地的需求。這點我自己也踩過坑,有些模型在 academic benchmark 上表現不錯,但一到 production 就會有奇怪的 failure mode。

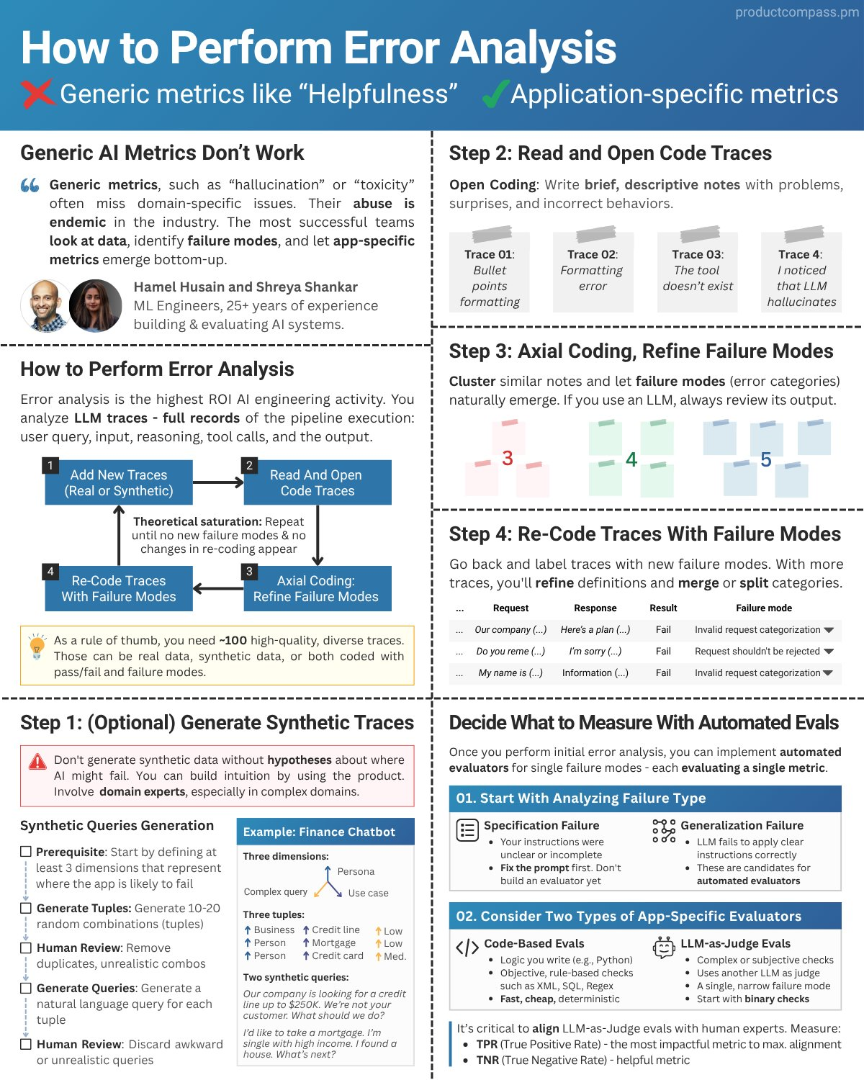

下面那張 error analysis process 我覺得滿好的:

第二:

他提到 human evals 的不可避免性,雖然大家都想要自動化,但很多細緻的能力,例如語言的細膩度、任務完成的合理性,還是需要人去判斷。這讓我想到,過去在做 chatbot 的時候,我們也常常得讓團隊實際用一陣子,再蒐集回饋,這種過程既麻煩又昂貴,但其實很重要。

第三:

我蠻認同的點是 評估需要有 context,也就是說,要先清楚自己要解決什麼問題,什麼才是 "好的輸出"。如果缺乏這個框架,再多指標都只是數字遊戲,我覺得這對現在很多為了 eval 而 eval 的研究或產品來說,是一個提醒。

整體來說,這篇文章雖然是 FAQ 形式,但把很多我們平常會遇到的誤區講得很清楚。推薦給正在設計 eval pipeline 的人讀一下,尤其是有打算把模型丟到真實場景的人。

另外站長可以開 eval 的子主題嗎?

作者:張家慶