大模型時代的 Audio Tokenizer 總結與思考

大語言模型拉開了大模型時代的序幕。大語言模型的核心機制是對文本序列建模:透過預測下一個詞或字,實現對語言結構和語義的理解與生成。由於文字已經是高度抽象的、符號化的表達,適合直接建模。

隨著大模型能力的拓展,多模態融合逐漸成為研究熱點。在眾多模態中,音訊是最重要、最常見的模態之一,廣泛出現在語音辨識、合成、聲紋、增強、音訊檢索、人機互動等應用。

然而,相較於文本,音頻具有以下特點:

連續性強

冗餘度高

資訊密度不均衡

這些特性使得音訊難以直接建模,需要轉化為系統或模型所能接受的表示形式,同時降低冗餘資訊並保留有用資訊。

在過去的幾十年中,音頻的表示形式經歷了從人工特徵工程到深度學習特徵表示再到Neural Audio Codec的演進:

傳統特徵工程:如MFCC、FBank 等,借鏡人類聽覺機制設計,具有實現簡單、計算高效等優勢,但表達能力有限。

深度學習表示:如自編碼器(AE)、變分自編碼器(VAE)的latent 向量,或基於Transformer 的HuBERT、Wav2Vec 等模型,在捕捉語音中的高層語意結構上表現更強。

Neural Audio Codec:最近成為主流方向。這類方法將音訊壓縮為離散token 序列,不僅方便大模型以自回歸方式建模,還支援語音的高品質重建,使得音訊的理解與生成任務可以統一建模。

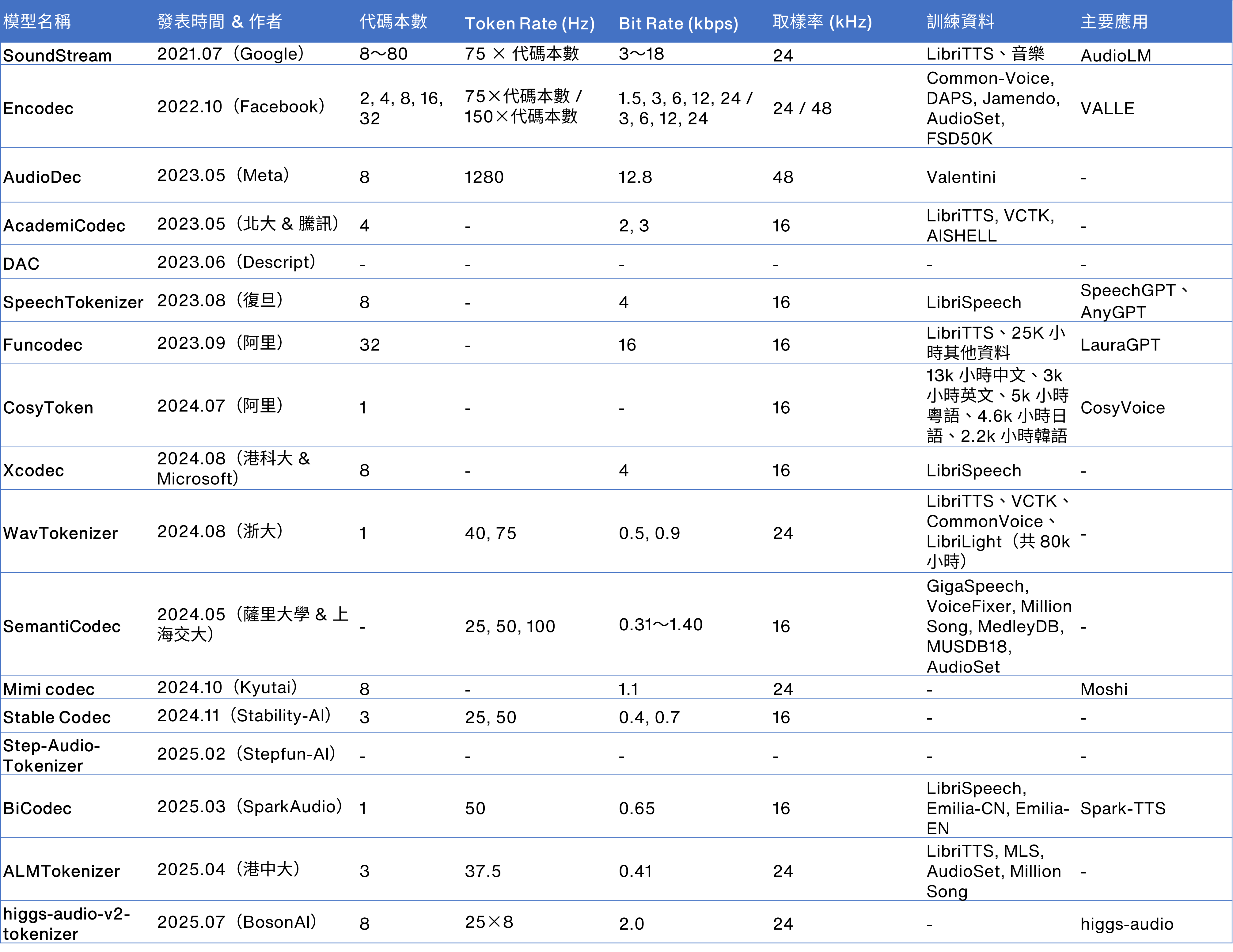

以下是目前出現的 Audio Tokenizer:

這篇文章帶大家詳細了解 Neural Audio Codec 模型,有興趣可以去看看

原作者:shuaijiang

作者:Chi