如何在成本、效能與資源限制之間取得平衡

講者:黃亮勳 | Twinkle AI | Founder

活動:9/17 Generative AI 年會小聚 2025

題目:如何在成本、效能與資源限制之間取得平衡

演講介紹

講者用很淺顯易懂的方式,帶我們看了 LLM 推論與訓練的現況,內容雖然技術細節不少,但表達得很清楚,覺得這些很值得企業內部規劃參考。

首先是 推論端的部署:

8/8號 OpenAI 釋出 GPT-OSS,其中 20B、120B 的模型,用 16GB VRAM 或早期的 H100 就能跑,部署在地端並不困難。

但要知道企業部署效果好不好,真正的問題是回覆速度到底行不行。講者秀了一張圖,比較 H100、Pro6000、 B200 等 GPU 的表現,

平均 token/s 不同顯卡差異不大,Pro6000 CUDA 跟新型 GPU 表現接近。 其中 B200,人數再多速度還是能坦的住。

但問題在使用者體感,現在大家都被養壞了,慢個一秒就覺得卡,實際上只是多了一個思考步驟,卻會被誤判為「超慢」。

這也是為什麼企業內部一定要有清楚的 P99 延遲圖表,才知道要買到什麼等級的 GPU。

再來是 繁中模型訓練:

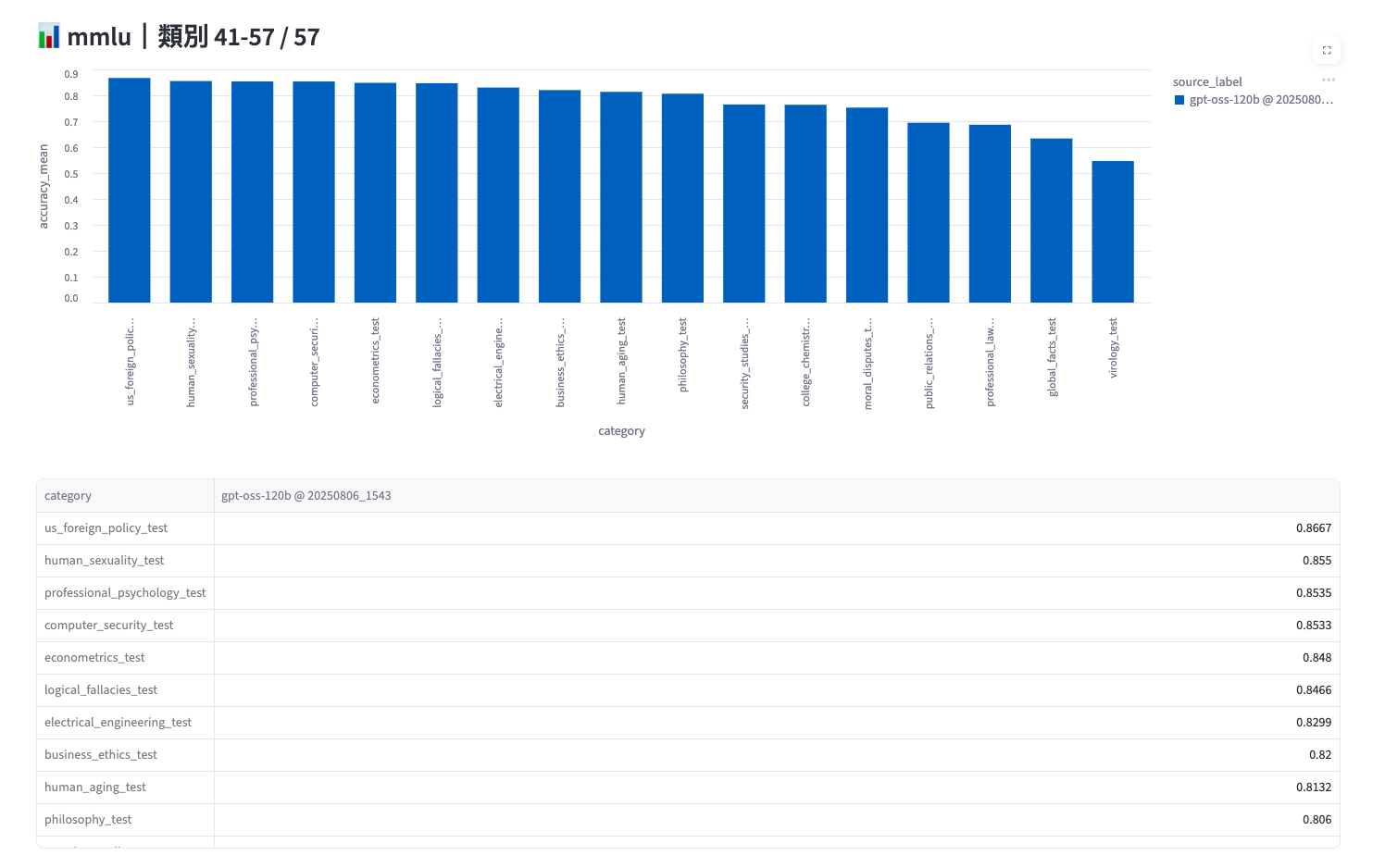

GPT-OSS 在 ikala 的 TMMLU+ 的 Benchmark 上,針對台灣在地議題表現還是很弱,該

評測結果可以在 Twinkle AI (傳送門) 上可以看到,每一筆都有,但普遍結果不佳。

更大的挑戰是解壓縮式訓練:

OpenAI 是將 20B、120B 量化,因此目前沒有一個訓練框架可以在他們的精度下去訓練模型

只能「解壓 → 漲上去」來跑,像 B200×8×3 的規模才撐得住。

幾乎所有市面上的繁中模型,都逃不過災難性遺忘的問題。

總結

新型 GPU 雖然成本高,但對大模型還是值得投資。

企業應該用 P99 延遲圖來規劃 GPU 配置,而不是被平均值誤導。

繁中模型要真正突破,硬體不是唯一解,還得補齊資料與框架的缺口。

特別推薦大家可以看看 Twinkle AI 收藏牆

跟上許多優質的課程

作者:Chi